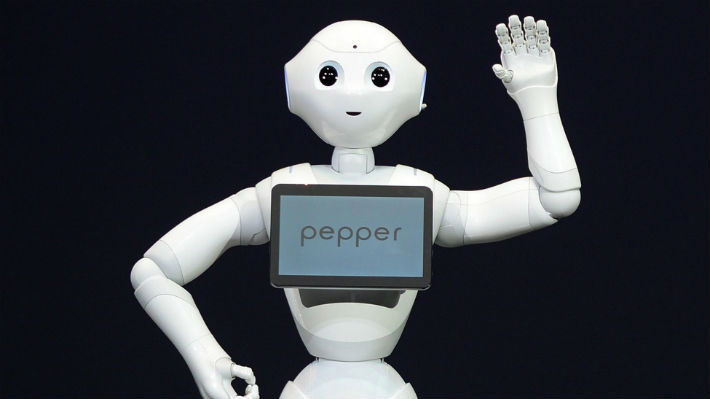

La Segunda (archivo/imagen referencial)

SANTIAGO.- Las opiniones en controversia sobre el desarrollo de inteligencia artificial no son algo nuevo. Desde importantes científicos como Stephen Hawking hasta empresarios del área como Elon Musk o Mark Zuckerberg han expuesto sobre esta situación, los avances y posibles peligros que podría generar esta tecnología.

El debate se ha vuelto a abrir luego de que Facebook debiese apagar a dos bots -robots operados con esta tecnología que habían sido diseñados para "aprender" a negociar entre ellos- luego de que comenzaran a hablar con frases que para los humanos no tenían sentido, pero, al parecer, para las máquinas sí.

Los problemas que genera la inteligencia artificial entre los expertos se basan en sus posibles aplicaciones en el futuro, si bien un escenario sacado de las películas de ciencia ficción puede verse lejano a la realidad actual, muchos creen que es el camino que se está creando. Muchas aplicaciones ya están en uso: varias compañías de tecnología (como Google, Apple, Amazon y Microsoft) cuentan con asistentes digitales, que prometen la capacidad de mantener conversaciones con los usuarios, responder preguntas y realizar tareas. Otros desarrollos apuestan por la creación de contenido, sea a través de la redacción de notas de prensa o la edición de videos en base a lo que un usuario captura con su teléfono (como lo ofrece Google Photos actualmente). Pero también existen desarrollos más avanzados, que buscan reemplazar a los trabajadores humanos en tareas de producción.

Ante esta situación se retoma la interrogante sobre el rol de la inteligencia artificial en el mundo, ¿un aporte o una amenaza? Expertos como el físico teórico Stephen Hawking han mostrado su postura sobre el tema en reiteradas ocasiones. Incluso, en julio de 2015 mil expertos -incluyendo al propio Hawking- enviaron una carta para evitar la construcción de armamento con esta tecnología.

A través de la misiva, en la que también firmaron personas como el cofundador de Apple, Steve Wozniak; Elon Musk, CEO de Space X y Tesla; Demis Hassabis, CEO de DeepMind -compañía dedicada a la inteligencia artificial-; entre otros, destacan los riesgos que significa poner a software con la capacidad de "pensar" al mando de armas y estrategias bélicas.

"Las armas autónomas han sido descritas como la tercera revolución bélica, después de la pólvora y las armas nucleares", expone la carta y profundiza en los peligros que significaría este desarrollo tecnológico.

Sin embargo, no todos están en contra de este desarrollo. Recientemente el fundador de Facebook, Mark Zuckerberg, se ha enfrentado indirectamente con Elon Musk sobre el tema. Según el ex estudiante de Harvard, la creación de estos sistemas puede contribuir en el avance de la tecnología.

"Creo que podemos construir cosas que pueden hacer este mundo un lugar mejor, especialmente con la inteligencia artificial", ha señalado el fundador de Facebook, compañía que utiliza actualmente inteligencia artificial en algunos de sus servicios y que cuenta con un área de desarrollo de esta tecnología. "Soy muy optimista. Creo que las personas que son negativas sobre esto e intentan proponer estos escenarios de fin del mundo son... creo que no lo entiendo", fueron las palabras de Zuckerberg.